- SnaqNews

- Posts

- Anthropic triplica de valor + Novo modelo de imagem do Google

Anthropic triplica de valor + Novo modelo de imagem do Google

E mais: Smart TVs com Copilot da Microsoft

Bom dia!

Hoje é dia de edição especial do Radar de IA – a cada 15 dias no seu e-mail só com o que interessa: um resumo claro e direto das novidades mais importantes em ferramentas e aplicações de IA.

O que você vai ver nesta edição:

Novo (e ótimo) modelo de imagem do Google

Anthropic capta US$ 13 bilhões e triplica de valor desde março

OpenAI reforça proteções do ChatGPT depois de processo

Novos lançamentos de modelos e ferramentas

GIRO DE NOTÍCIAS

NANO BANANA

O Google lançou o Gemini 2.5 Flash Image (apelidado de nano-banana), modelo avançado de geração e edição de imagens que resolve grandes desafios da área.

Imagem editada com o Gemini 2.5 Flash Image

Por que ele é interessante? O modelo mantém consistência de personagens através de múltiplos prompts, permite transformações precisas via linguagem natural e combina múltiplas imagens em uma única imagem. Ele já está disponível via Gemini API, AI Studio e Vertex AI. Isso significa que, diferente de modelos antigos, ele não “se perde” ao tentar repetir o mesmo personagem ou misturar diferentes imagens.

O diferencial é integrar o conhecimento de mundo do Gemini, superando modelos tradicionais que produzem apenas imagens esteticamente agradáveis sem compreensão semântica profunda. Isso permite casos de uso educacionais, como tutores interativos que interpretam diagramas desenhados à mão.

O Google criou vários aplicativos template demonstrando funcionalidades como edição de fotos, fusão de imagens e consistência de personagens. Todas as imagens incluem marca d'água SynthID invisível para identificação como conteúdo gerado por IA.

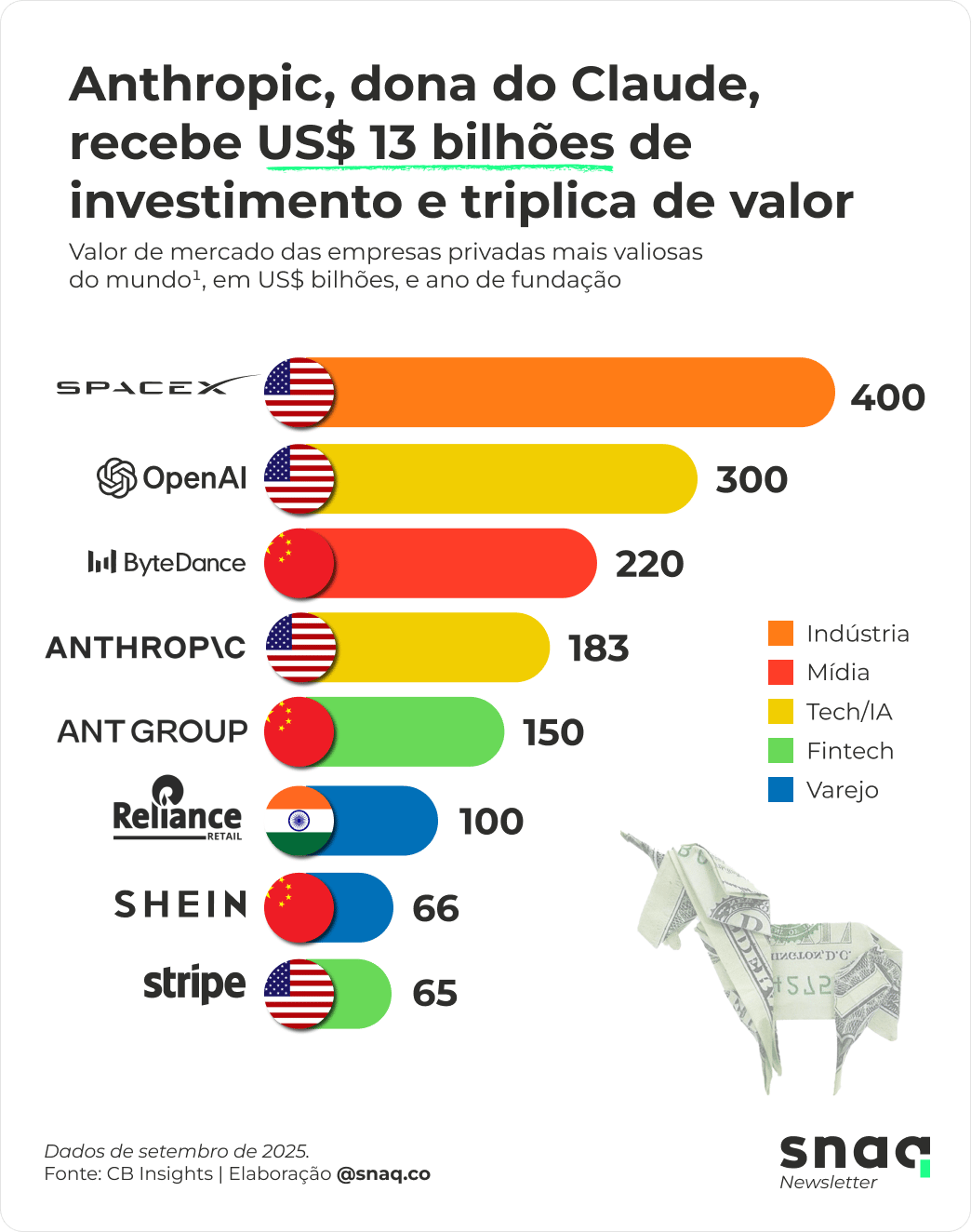

ANTHROPIC VALE US$ 183 BI DEPOIS DE NOVA RODADA

A Anthropic anunciou uma rodada Série F de US$ 13 bilhões que aumentou seu valuation para US$ 183 bilhões (~3x seu valor de mercado de março). O aporte, liderado pela Iconiq, Fidelity e Lightspeed, contou também com investidores de peso como BlackRock, Blackstone, Coatue, Insight Partners, Qatar Investment Authority, entre outros. A empresa disse que o capital será usado para expandir a adoção corporativa, aprofundar pesquisas em segurança e acelerar sua expansão internacional.

Os números do fenômeno: o crescimento da Anthropic em 2025 foi impressionante, com receita anual recorrente que saltou de US$ 1 bilhão para US$ 5 bilhões, apoiada no aumento do uso de sua API e na adoção empresarial. Hoje, a companhia atende mais de 300 mil clientes corporativos, com o número de grandes contas crescendo quase 7x em um ano.

Um dos destaques é o Claude Code, focado no desenvolvimento de software apoiado por agentes de IA, que já gera mais de US$ 500 milhões em receita anualizada, com uso multiplicado por 10 apenas nos últimos três meses. Esse ritmo de crescimento tem atraído a atenção de investidores, mas também força a empresa a captar grandes quantias para competir com rivais como OpenAI e Cursor.

OpenAI REFORÇA PROTEÇÕES DO ChatGPT DEPOIS DE PROCESSO

A OpenAI anunciou mudanças no ChatGPT para lidar melhor com sinais de sofrimento mental após ser processada pelos pais de um adolescente que tirou a própria vida. As atualizações incluem reforço dos mecanismos de contenção (guardrails) em diálogos longos, recomendações mais consistentes sobre saúde mental, integração com serviços de emergência e controles para pais. Procuradores-gerais dos EUA já haviam alertado empresas de IA sobre sua responsabilidade legal na proteção de menores.

VOLTA RÁPIDA

A Anthropic começará a usar transcrições de chats e sessões de código de usuários para treinar seus modelos, a menos que estes optem por não participar. A retenção de dados será estendida para cinco anos e a medida vale a partir de 28 de setembro de 2025.

As mudanças afetam apenas usuários de consumo, e o aceite padrão vem ativado, exigindo atenção para quem deseja recusar. A empresa afirma que filtra dados sensíveis e não vende informações a terceiros.

A Anthropic fechou acordo em processo bilionário por direitos autorais após ser acusada de piratear 7 milhões de livros para treinar o Claude. Com danos potenciais de US$ 900 bilhões contra receita prevista de apenas US$ 5 bilhões em 2025, a empresa evitou um julgamento que poderia ter sido fatal para seus negócios.

Elon Musk processou Apple e OpenAI por suposta conspiração anticompetitiva, alegando que a parceria entre as empresas favorece o ChatGPT na App Store em detrimento do Grok. A OpenAI rebateu chamando de "assédio", enquanto evidências mostram que outras IAs como DeepSeek e Perplexity alcançaram o topo da App Store após a parceria Apple-OpenAI.

A Anthropic lançou o Claude para Chrome, uma extensão de IA que funciona em janela lateral do navegador para 1.000 assinantes premium. A iniciativa marca a entrada da empresa na batalha dos navegadores inteligentes, competindo com o Comet da Perplexity e o futuro navegador da OpenAI.

A Microsoft lançou o Copilot integrado às novas TVs e monitores da Samsung. O assistente é capaz de sugerir filmes e séries, fazer recaps de episódios sem spoilers, trazer informações sobre atores, atletas e eventos, além de responder a perguntas gerais como clima e resultados esportivos e ajudar em tarefas de aprendizado, como explicar conceitos ou auxiliar em idiomas.

Ao fazer login no aplicativo, o usuário ainda garante uma experiência personalizada, já que o Copilot passa a levar em conta interações anteriores e preferências. A expectativa é que, no futuro, a integração seja expandida para mais aparelhos e até outras marcas, como a LG.

A Perplexity AI lançou um programa de compartilhamento de receita de US$ 42,5 milhões para remunerar publishers cujos conteúdos apareçam em buscas, no navegador Comet ou no assistente de IA. O financiamento virá em parte da assinatura Comet Plus (US$ 5/mês), que destinará 80% da receita aos veículos.

A medida ocorre em meio a disputas legais e acusações de uso indevido de conteúdo, enquanto a startup avaliada em US$ 18 bilhões tenta se posicionar como alternativa ao Google.

A OpenAI liberou o Realtime API para todos os desenvolvedores e lançou o gpt-realtime, seu modelo de voz mais avançado. Entre as novidades estão suporte a MCP, análise de imagens, chamadas telefônicas e vozes mais realistas.

O gpt-realtime promete maior naturalidade, execução de instruções complexas e até troca de idioma em tempo real, reforçando a aposta da empresa de que o futuro da interação com IA será predominantemente por voz.

MODELOS

A Microsoft AI lançou dois modelos próprios para reduzir dependência de terceiros: MAI-Voice-1 e MAI-1-preview.

MAI-Voice-1 é um modelo de geração de fala que produz um minuto de áudio em menos de um segundo, já disponível no Copilot Daily e Labs. Oferece áudio expressivo de alta fidelidade para cenários únicos e múltiplos oradores, representando uma interface interessante para futuros agentes de IA.

MAI-1-preview é o primeiro modelo de base da empresa treinado end-to-end, testado publicamente no LMArena. É um modelo mixture-of-experts, especializado em seguir instruções e responder consultas cotidianas. Será implementado no Copilot nas próximas semanas, mas ainda mantendo o uso de modelos de terceiros (fechados e open source).

O primeiro modelo de codificação agêntica da xAI, focado em execução autônomas de tarefas de programação, se destaca pela velocidade extraordinária de 160 tokens por segundo, superando GPT-5 (50,1 tp/s), Gemini 2.5 Pro (92,4 tp/s) e Claude 4 Sonnet (78,7 tp/s).

Disponível gratuitamente por tempo limitado através de GitHub Copilot e Windsurf, o modelo posteriormente custará 20 centavos por milhão de tokens de entrada e US$ 1,50 por milhão de saída. Com taxa de acerto de cache acima de 90% e 70,8% de aprovação no SWE-Bench-Verified, compete diretamente com GitHub Copilot da Microsoft e Codex da OpenAI.

O Allen Institute lançou OLMoASR, família de modelos de reconhecimento de fala open-source que compete com Whisper da OpenAI. Com dataset curado de 3 milhões de horas e abordagem "data-first", alcança 12,8% WER comparável ao Whisper (medium), mas com completa transparência: dados, código e modelos totalmente abertos para reprodutibilidade científica.

Modelo TTS (Text to Speech) open-source que gera conversas realistas de até 90 minutos com 4 oradores diferentes. Usando tokenizadores a 7,5 Hz e LLM Qwen2.5-1.5B, supera limitações tradicionais, mas inclui avisos automáticos "gerado por IA" e marca d'água para prevenir deepfakes, funcionando apenas em inglês e chinês.

O USO (Unified Style-Subject Optimized), é um modelo de geração que une consistência de identidade e fidelidade de estilo em imagens. Treinado com um dataset de trios de imagens, ele utiliza aprendizado desatrelado (aprende coisas distintas em relação a cada imagem) e um mecanismo de recompensa de estilo para equilibrar acurácia e estética.

Além de superar métodos anteriores em benchmarks, o USO disponibiliza o USO-Bench, a primeira métrica conjunta para avaliar estilo e identidade. O projeto será open source, com código, pesos e datasets liberados sob Apache 2.0.

Imagem gerada com USO (Unified Style-Subject Optimized)

*Curadoria de notícias da seção e comentários feitos por Rafael Girolineto, AI expert, parceiro da Snaq e Data & AI Manager da Inspira

Decidir sobre IA nos negócios começa por entender o essencial.

Por isso estamos construindo um programa feito para líderes que precisam entender IA com clareza, para conversar com seus times, fazer escolhas com segurança e preparar o negócio para os próximos meses e anos.

Quer ser avisado em primeira mão? Entre na lista de espera aqui.

Aqui na Snaq, acreditamos que as melhores marcas são aquelas que compartilham conhecimento e se tornam thought leaders para a sociedade!

Quer ser nosso parceiro nessa missão de compartilhar inteligência e educação sobre inovação? Manda uma mensagem pra gente!

O que achou dessa edição? |

Faça Login ou Inscrever-se para participar de pesquisas. |